El Problema con las Acciones Ciegas

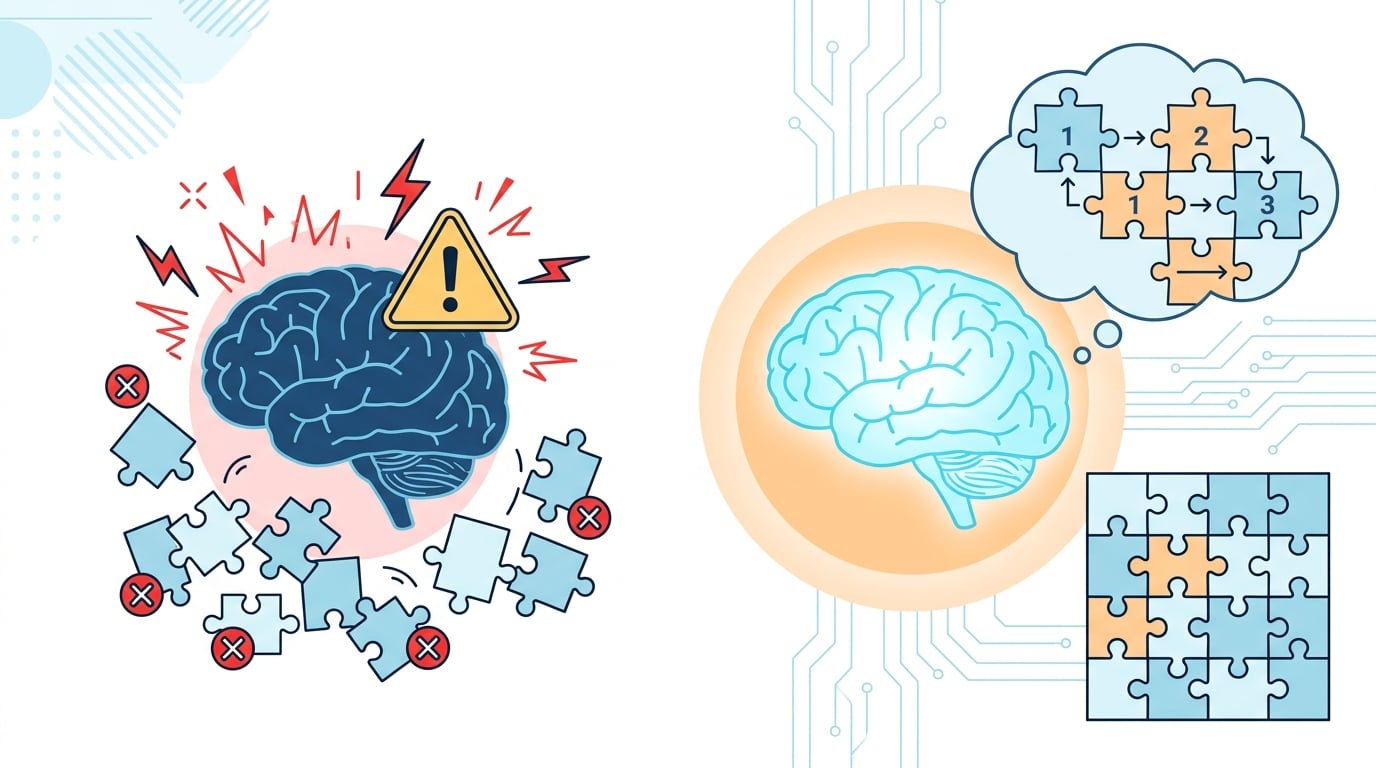

Al resolver problemas lógicos complejos o recuperar múltiples piezas de información, obligar a una IA a decidir inmediatamente sobre una acción puede provocar errores catastróficos.

Piensa en cómo una persona resuelve un rompecabezas:

- No simplemente agarran una pieza al azar y la insertan en el tablero.

- Mentalmente o verbalmente trazan una estrategia: "Primero, necesito encontrar las piezas con bordes planos para el marco, luego veré si esta pieza azul encaja."

De manera similar, si le pedimos a una IA solo que solo produzca una acción, omitiendo la fase de razonamiento, está actuando ciegamente. A menudo adivina, hallucina o elige completamente la herramienta equivocada porque no ha definido los requisitos previos para responder la pregunta.

Pensar en Voz Alta

Los modelos de lenguaje construyen la lógica token por token. Al obligar a la IA a pensar en voz alta (generar texto que analice el problema) antes de seleccionar una acción, le proporcionamos el espacio necesario para llegar a la conclusión lógica correcta.